인공 신경망에 사용되는 활성함수의 확률적 구현방법 및 그를 포함하는 시스템

문희곤

hgmoon@gist.ac.kr

062-715-3077

기술개요

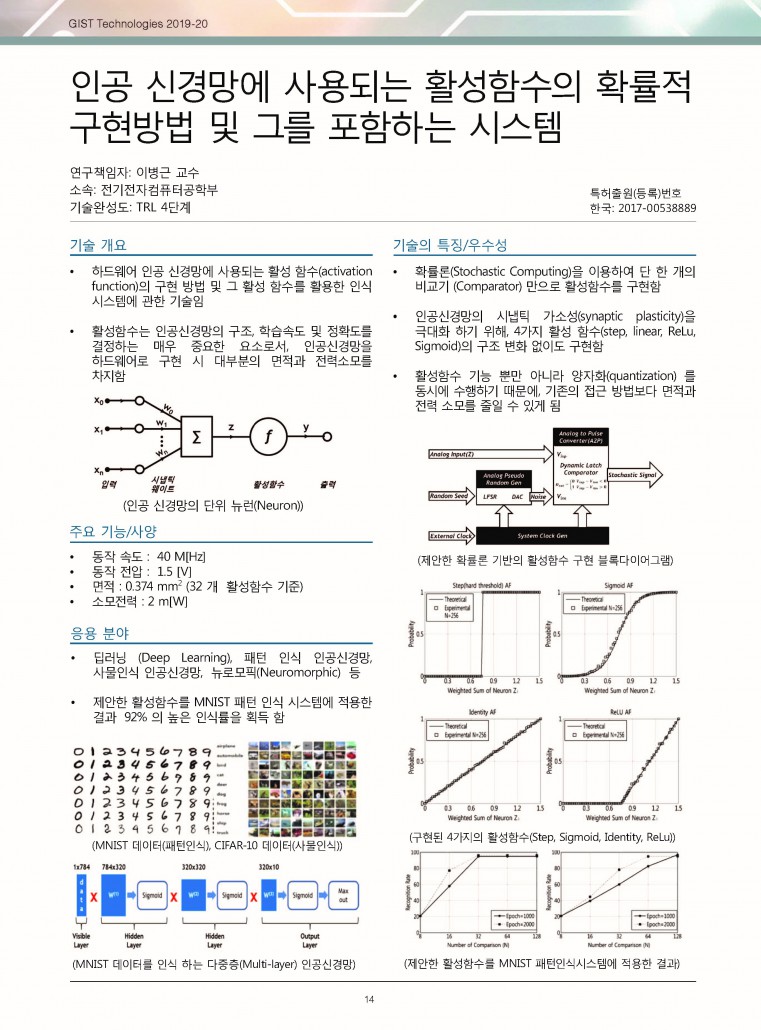

- 하드웨어 인공 신경망에 사용되는 활성 함수(activation function)의 구현 방법 및 그 활성 함수를 활용한 인식 시스템에 관한 기술임

- 활성함수는 인공신경망의 구조, 학습속도 및 정확도를 결정하는 매우 중요한 요소로서, 인공신경망을 하드웨어로 구현 시 대부분의 면적과 전력소모를 차지함

기술의 특징/우수성

- 확률론(Stochastic Computing)을 이용하여 단 한 개의 비교기(Comparator)만으로 활성함수를 구현함

- 인공신경망의 시냅틱 가소성(synaptic plasticity)을 극대화 하기 위해, 4가지 활성 함수(step, linear, ReLu, Sigmoid)의 구조 변화 없이도 구현함

- 활성함수 기능 뿐만 아니라 양자화(quantization)를 동시에 수행하기 때문에, 기존의 접근 방법보다 면적과 전력 소모를 줄일 수 있게 됨

주요기능/사양

- 동작속도: 40M[Hz]

- 동작전압: 1.5[V]

- 면적: 0.374mm2 (32개 활성함수 기준)

- 소모전력: 2m[W]

응용분야

- 딥러닝(Deep Learning), 패턴 인식 인공신경망, 사물인식 인공신경망, 뉴로모픽(Neuromorphic) 등

- 제안한 활성함수를 MNIST 패턴 인식 시스템에 적용한 결과 92%의 높은 인식률을 획득함